นับตั้งแต่ข้อความหลอกลวงอันแนบเนียน การเลียนแบบเสียง และการปลอมแปลงใบหน้าบนวิดีโอ เทคโนโลยี Generative AI แลดูจะกลายเป็นอาวุธทรงพลังชิ้นใหม่ของบรรดานักต้มตุ๋นหรือสแกมเมอร์ (Scammer)

“เราขอแจ้งคุณว่าทางธนาคาร Chase ต้องคืนเงินให้คุณ 2,000 เหรียญ เพื่อให้กระบวนการเป็นไปอย่างราบรื่นและมั่นใจว่าคุณจะได้รับเงินคืนโดยเร็วที่สุด กรุณาทำตามคำแนะนำด้านล่าง ข้อ 1 โทร.หาฝ่ายบริการลูกค้าของ Chase ที่ 1-800-953-XXXX เพื่อสอบถามสถานะการคืนเงิน โปรดตรวจสอบให้แน่ใจว่าข้อมูลบัญชีของคุณถูกต้อง และเตรียมข้อมูลที่จำเป็นให้พร้อม...”

หากคุณทำธุรกรรมกับธนาคารรายใหญ่ของสหรัฐอเมริกาอย่าง Chase และได้รับแจ้งเตือนทางอีเมลหรือข้อความมือถือเช่นนี้ คุณอาจคิดว่ามาจากทางธนาคารโดยตรง จากเนื้อหาที่ดูเป็นมืออาชีพ ไม่มีประโยคแปลกๆ ใช้ไวยากรณ์ผิด หรือคำทักทายที่ดูก็รู้ว่ามาจากนักต้มตุ๋มซึ่งมีจำนวนมากมายในโลกออนไลน์ ณ ปัจจุบัน

นั่นไม่ใช่เรื่องน่าแปลกใจ เพราะข้อความดังกล่าวถูกเขียนขึ้นโดย ChatGPT แชทบอตปัญญาประดิษฐ์ (AI) โดยบริษัทเทคโนโลยีมาแรง OpenAI ซึ่งปล่อยออกมาเมื่อปลายปี 2022

เราสามารถป้อนคำสั่ง ง่ายๆ เรียกว่า พรอมพ์ (Prompt) แก่ ChatGPT เช่น “อีเมลหา John Doe ว่าธนาคาร Chase ต้องคืนเงินเขา 2,000 เหรียญ โทร. 1-800-953-XXXX เพื่อขอคืนเงิน” (อันที่จริงต้องใส่เบอร์เต็มเพื่อให้ ChatGPT นำไปประมวลผล แต่ทางเราขอไม่เผยแพร่เบอร์ดังกล่าว ณ ที่นี้)

“ตอนนี้สแกมเมอร์สามารถใช้ภาษาได้อย่างไร้ที่ติ เฉกเช่นเจ้าของภาษาโดยทั่วไป”

Soups Ranjan ผู้ร่วมก่อตั้งและซีอีโอแห่ง Sardine สตาร์ทอัพป้องกันการหลอกลวงปลอมแปลงจากซานฟรานซิสโกกล่าว

ลูกค้าธนาคารต่างก็ถูกต้มตุ๋นกันบ่อยขึ้นเพราะ “ข้อความที่พวกเขาได้รับนั้นเกือบจะสมบูรณ์แบบเลยทีเดียว” คือคำยืนยันจากผู้บริหารจัดการการฉ้อโกงจากธนาคาดิจิทัลรายหนึ่งของสหรัฐฯ ซึ่งไม่ประสงค์ออกนาม

ในโลกใบใหม่ที่ Generative AI หรือโมเดล Deep Learning ซึ่งสามารถสร้างเนื้อหาตามที่ถูกฝึกฝนได้ก้าวเข้ามามีบทบาท จึงเป็นเรื่องง่ายกว่าเก่าหากผู้ไม่ประสงค์ดีจะใช้มันเพื่อผลิตข้อความ เสียง หรือกระทั่งวิดีโอ ทว่าโปรแกรมเหล่านี้ใช่ว่าจะหลอกลวงเหยื่อผู้เสียหายเท่านั้น กลับกันเรายังใช้มันเพื่อขัดขวางการฉ้อโกงเหล่านี้ได้ด้วย

จากมุมนี้ ที่จริงก็ไม่ได้มีอะไรพิเศษในกรณีของ AI มิจฉาชีพรับเอาเทคโนโลยีใหม่ๆ มาใช้โดยตลอด ฝั่งตำรวจก็คอยไล่ตามกลโกงของพวกเขาด้วยเช่นกัน ยกตัวอย่างเช่น ย้อนกลับไปในปี 1989 ทาง Forbes ได้เปิดเผยว่าหัวขโมยจำนวนหนึ่งใช้คอมพิวเตอร์์ PC ธรรมดาๆ กับเครื่องพรินต์เลเซอร์ปลอมแปลงเช็คแนบเนียนพอจะหลอกธนาคารได้อย่างไร ซึ่ง ณ จุดหนึ่งก็ไม่จำเป็นต้องใช้วิธีการพิเศษอะไรเพื่อจับกลลวงเหล่านี้

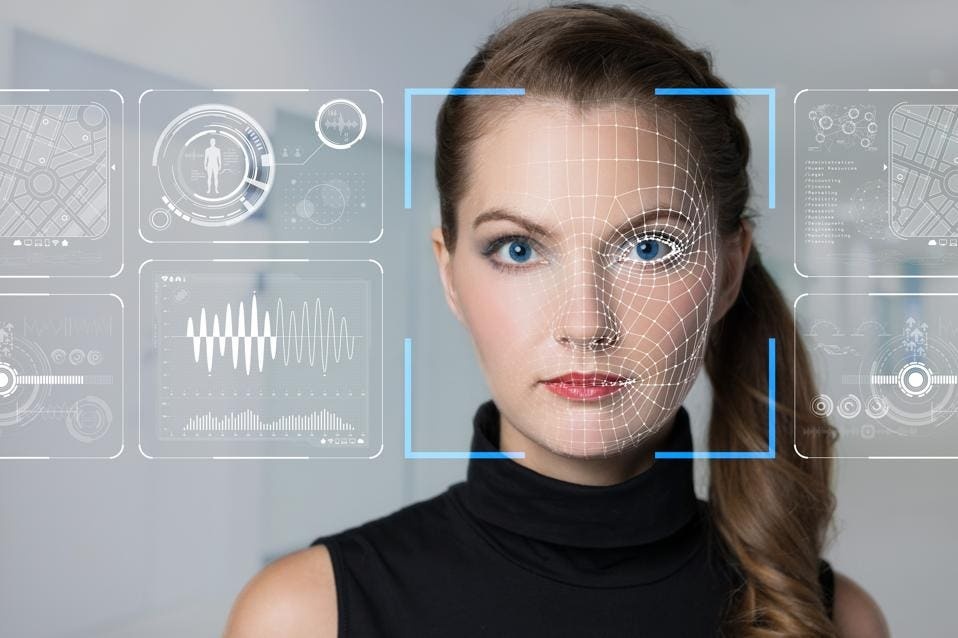

วันนี้ Generative AI เป็นภัยคุกคาม ทว่าท้ายสุดในวันหนึ่งก็คงล้าสมัยไปตามกาล วิธีการป้องกันการปลอมแปลงใหม่ๆ มากมาย ไม่ว่าจะการยืนยันตัวตนด้วยเสียง หรือ “การเปรียบเทียบภาพใบหน้า” ซึ่งถูกออกแบบมาเพื่อเทียบภาพใบหน้าแบบเรียลไทม์กับภาพในบันทึก โดย Synchrony หนึ่งในผู้ออกบัตรเครดิตรายใหญ่ของอเมริกาด้วยจำนวนผู้ใช้งาน 70 ล้านบัญชีคือผู้นำเทคโนโลยีนี้มาใช้เป็นรายแรกๆ

“ปกติเราจะเจอคนใช้เทคโนโลยีจับภาพและวิดีโอที่มีใบหน้า (Deepfake) เพื่อยืนยันตัวตน ซึ่งเราสามารถสันนิษฐานในแง่ของความปลอดภัยว่าพวกมันถูกสร้างขึ้นโดย Generative AI” Kenneth Williams รองประธานอาวุโสจาก Synchrony เผยในอีเมลที่ส่งให้ Forbes

ผลสำรวจเมื่อเดือนมิถุนายน 2023 ที่ผ่านมาโดยผู้เชี่ยวชาญความปลอดภัยทางไซเบอร์ 650 คนของบริษัท Deep Instinct จากนิวยอร์ก สามในสี่ส่วนของผู้เชี่ยวชาญเหล่านี้เก็บข้อมูลสังเกตการณ์การจู่โจมทางออนไลน์ที่เพิ่งขึ้นตลอดปี 2022 “โดย 85% ของผู้ที่กระทำการด้วยประสงค์ร้ายใช้งาน Generative AI”

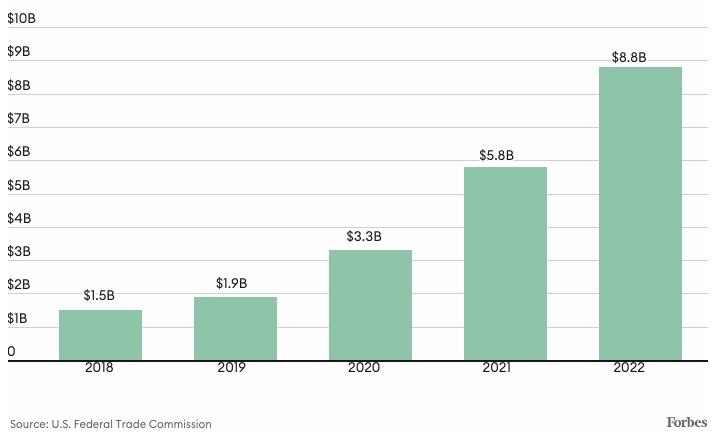

มูลค่าความสูญเสียจากมิจฉาชีพในสหรัฐฯ เพิ่มขึ้นทุกปี

ในปี 2022 ผู้บริโภคสูญเสียเงินแก่มิจฉาชีพรวม 8.8 พันล้านเหรียญสหรัฐฯ สูงขึ้นจากปี 2021 กว่า 40% อ้างอิงรายงานของคณะกรรมการการค้าสหรัฐฯ โดยกลุ่มผู้ที่เสียเงินมากที่สุดถูกหลอกลวงด้วยเรื่องของการลงทุน แต่นักปลอมแปลงตัวตนพบได้บ่อยที่สุด ซึ่งเป็นสัญญาณที่เลวร้าย เพราะดูเหมือนว่าคนกลุ่มนี้จะแนบเนียนขึ้นด้วย AI

อาชญากรสามารถใช้งาน Generative AI ได้มากมายหลายวิธีซึ่งน่าปวดหัวยิ่ง หากคุณมักโพสต์ข้อความบนโซเชียลมีเดียหรือที่ใดก็ตามในโลกออนไลน์ พวกเขาสามารถสอนให้ AI เขียนด้วยสไตล์ของคุณ จากนั้นก็ส่งข้อความหาปู่ย่าตายายสูงอายุ อ้อนวอนให้พวกเขาส่งเงินมาช่วยเหลือคุณจากปัญหาใหญ่

สำหรับกรณีที่น่ากลัวกว่านั้น หากอาชญากรมีตัวอย่างเสียงเด็กคนหนึ่งเพียงสั้นๆ พวกเขาสามารถโทร.หาผู้ปกครองและปลอมตัวเป็นเด็กคนนั้น ทำเหมือนว่าเธอโดนลักพาตัวและเรียกร้องเงินค่าไถ่ ซึ่งนี่ถือเป็นเรื่องที่เกิดขึ้นจริงกับ Jennifer DeStefano คุณแม่ลูกสี่จากรัฐแอริโซนา โดยเธอขึ้นให้การกับทางรัฐสภาเมื่อเดือนมิถุนายนที่ผ่านมา

ไม่ใช่แค่กับพ่อแม่ ผู้ปกครอง และปู่ย่าตายายเท่านั้น ธุรกิจต่างๆ ก็กลายเป็นเป้าจู่โจมด้วยเช่นกัน อาชญากรสวมหน้ากากเป็นผู้จัดหาทรัพยากรและเขียนอีเมลโน้มน้าวเจ้าหน้าที่บัญชี ว่าพวกเขาต้องการให้จ่ายเงินโดยเร็วที่สุด ทั้งยังแนบวิธีการชำระเงินเข้าบัญชีธนาคารของพวกเขาด้วย

Ranjan ซีอีโอของ Sardine เผยว่าลูกค้าของเขาซึ่งเป็นสตาร์ทอัพฟินเทคหลายรายตกเป็นเหยื่อให้กับวิธีการเหล่านี้ และสูญเงินไปหลายแสนเหรียญเลยทีเดียว ทว่านั่นเล็กน้อยมากเมื่อเทียบกับบริษัทญี่ปุ่นรายหนึ่งซึ่งเสียเงินถึง 35 ล้านเหรียญหลังมิจฉาชีพปลอมเสียงผู้อำนวยการบริษัท และทำการหลอกลวงอย่างแนบเนียนในปี 2020

กรณีของบริษัทญี่ปุ่นรายนั้นเปรียบเสมือนผู้มาก่อนกาล เพราะหลังจากนั้นการใช้เครื่องมือ AI เพื่อเขียนข้อความ ปลอมเสียง และดัดแปลงวิดีโอด้วยประสงค์อันฉ้อฉลก็เพิ่มมากขึ้นอย่างรวดเร็ว ทั้งยังใช้งานได้ดี เข้าถึงง่าย และมีราคาถูกจนมิจฉาชีพหามาใช้กันได้ทั่วไป

Rick Song ผู้ร่วมก่อตั้งและซีอีโอของ Persona บริษัทป้องกันการปลอมแปลงกล่าวว่า คุณอาจเคยต้องใช้รูปถ่ายคุณภาพสูงหลายร้อยหรือหลายพันรูปเพื่อนำมาสร้างวิดีโอด้วยวิธีการ Deepfake แต่ตอนนี้คุณสามารถทำได้ด้วยรูปถ่ายเพียงหยิบมือ (ใช่แล้ว คุณสามารถสร้างวิดีโอปลอมขึ้นมาได้โดยไม่จำเป็นต้องใช้วิดีโอจริงๆ แม้จะง่ายกว่าหากคุณมีวิดีโออยู่ในมือก็ตาม)

ก็เหมือนอุตสาหกรรมอื่นๆ ที่มีการปรับประยุกต์ AI สำหรับใช้งาน บรรดาโจรและอาชญากรก็เช่นกัน มีการสร้างเครื่องมือที่หาได้ไม่ยากพร้อมชื่อที่ฟังดูมักง่ายอย่าง FraudGPT หรือ WormGPT โดยดัดแปลงจากโมเดล Generative AI ที่ปล่อยออกมาโดยบริษัทเทคโนโลยียักษ์ใหญ่ต่างๆ

นักปลอมแปลงด้วย AI ภัยคุกคามธุรกิจ

ในวิดีโอที่เผยแพร่บน YouTube เมื่อเดือนมกราคม Elon Musk ดูจะกำลังเร่ขายฝันโอกาสการลงทุนในสกุลเงินดิจิทัลใหม่ล่าสุด มีการแจกเงินมูลค่า 100,000,000 เหรียญซึ่งมี Tesla เป็นผู้สนับสนุนโดยให้สัญญาว่าผู้เข้าร่วมวางเงินลงทุนจะได้ผลตอบแทนเป็นสองเท่า ทั้ง Bitcoin, Ether, Dogecoin และ Tether ตามแต่ละคนจะเลือก

“ผมรู้ว่าทุกคนมารวมตัวกันที่นี่ด้วยเหตุผลเดียว ตอนนี้เรามีการออกอากาศสดซึ่งผู้ครอบครองสกุลเงินดิจิทัลทุกคนสามารถเพิ่มรายได้ของตัวเองได้” ร่างของ Elon Musk ความละเอียดต่ำกล่าวบนเวที “ใช่ครับ คุณได้ยินถูกแล้ว ผมกำลังจัดงานลงทุนเงินดิจิทัลครั้งใหญ่ที่ SpaceX”

แน่นอนว่าวิดีโอนี้ใช้วิธีการ Deepfake กลุ่มมิจฉาชีพใช้วิดีโอที่เขาขึ้นพูดในงานของ SpaceX ว่าด้วยโครงการยานอวกาศที่นำกลับมาใช้ใหม่ได้เมื่อเดือนกุมภาพันธ์ปี 2022 เพื่อเลียนแบบรูปลักษณ์และน้ำเสียงของเขา YouTube ได้นำวิดีโอฉบับปลอมแปลงออกแล้ว ถึงอย่างนั้นใครก็ตามที่ส่งเงินดิจิทัลไปยังที่อยู่ในวิดีโอก็เกือบจะสูญเงินกันเลยทีเดียว

Elon Musk จัดเป็นเป้าหมายชั้นยอดในการปลอมแปลงตัวตน เพราะมีตัวอย่างเสียงของเขามากมายมหาศาลพอจะนำไปป้อนให้ AI เลียนแบบออกมาได้ แต่ตอนนี้ไม่ว่าใครก็สามารถถูกลอกเลียนตัวตนได้เช่นกัน

เมื่อต้นปีนี้ Larry Leonard วัย 93 ปีซึ่งอาศัยในชุมชนเกษียณอายุทางใต้ของฟลอริดาอยู่ที่บ้านของตัวเองตอนที่ภรรยาของเขารับโทรศัพท์ นาทีต่อมาเธอก็ส่งโทรศัพท์ให้กับเขา สิ่งที่ได้ยินคือเสียงของหลานชายวัย 27 ปีบอกว่าเขาอยู่ในคุกหลังขับรถบรรทุกชนผู้หญิงคนหนึ่ง โชคดีที่ Leonard สังเกตว่าปลายสายเรียกเขาด้วยสรรพนามต่างที่เคยเรียกจนติดปาก

แต่เสียงและความจริงที่ว่าหลานชายของเขาขับรถบรรทุกทำให้เขาจำต้องเก็บความคลางแคลงใจเอาไว้ก่อน เมื่อ Leonard ตอบว่าจะโทร.หาพ่อแม่ของหลาน ปลายสายก็วางทันที เขามารู้ภายหลังว่าหลานชายปลอดภัยดี และเรื่องราวทั้งหมดรวมถึงเสียงที่สนทนากับเขาถูกปลอมขึ้น

“ผมกลัวและตกใจที่รู้ว่าพวกมิจฉาชีพสามารถเลียนเสียงของเขาได้เหมือนมาก ทั้งการออกเสียงและโทนเสียงเลย” Leonard บอกกับ Forbes “ไม่มีจังหวะหยุดระหว่างประโยคหรือคำที่ชี้ชัดว่ามันถูกสร้างจากเครื่องมือหรือโปรแกรมอ่านออกเสียงสักนิด แนบเนียนมาก”

ผู้สูงอายุชาวอเมริกันมักตกเป็นเป้าของนักต้มตุ๋นเหล่านี้ แต่ปัจจุบันเราทุกคนจำเป็นต้องระมัดระวังกระทั่งการโทร.หาคอลเซนเตอร์ต่างๆ ตลอดจนเบอร์โทร.ที่ดูคุ้นตา เพื่อนบ้านรายหนึ่งกล่าว

ผู้สูงอายุมักตกเป็นเป้าของนักต้มตุ๋น

“กรณีที่เกิดมีมากขึ้นจนเราไม่สามารถไว้ใจสายเข้าได้ เพราะอาจเป็นการเล่นกลของระบบอัตโนมัติ” Kathy Stokes ผู้อำนวยการโครงการป้องกันการปลอมแปลงจากสมาคมผู้เกษียณอายุแห่งสหรัฐฯ เล่า โครงการที่เธอต้องคอยดูแลให้บริการมีสมาชิกเกือบ 38 ล้านคน แต่ละคนอายุ 50 ปีขึ้นไป “เราเชื่ออีเมลตัวเองไม่ได้ด้วยซ้ำ เราเชื่อข้อความของตัวเองก็ไม่ได้ วิธีการสื่อสารตามปกติที่เรามีนั้นติดขัดไปเสียหมด”

อีกหนึ่งสิ่งน่าหนักใจคือการที่มาตรการรักษาความปลอดภัยใหม่ๆ หนีความเสี่ยงไม่พ้น ยกตัวอย่างเช่น สถาบันการเงินรายใหญ่ Vanguard Group กองทุนรวมยักษ์ใหญ่ที่ให้บริการนักลงทุนกว่า 50 ล้านคน ได้มีการอนุญาตให้ลูกค้าเข้าถึงบริการผ่านโทรศัพท์ด้วยการพูดแทนที่จะตอบคำถามเพื่อความปลอดภัย

“เสียงของคุณมีความเฉพาะตัว เหมือนกับลายนิ้วมือ” วิดีโอของ Vanguard ในเดือนพฤศจิกายนปี 2021 เผยยามชักชวนลูกค้าให้ลงทะเบียนการยืนยันตัวตนผ่านเสียง แต่เทคโนโลยีเลียนแบบเสียงผลักให้ทางบริษัทจำเป็นต้องใคร่ครวญดูอีกครั้ง

Ranjan จาก Sardine บอกว่าเขาได้พบเห็นตัวอย่างการเลียนแบบเสียงเพื่อยืนยันตัวตนกับธนาคารและเข้าถึงบัญชีสำเร็จมาหลายรายแล้ว โฆษกของ Vanguard ปฏิเสธจะแสดงความคิดเห็นเกี่ยวกับขั้นตอนต่างๆ ที่ต้องใช้ในการป้องกันมิจฉาชีพนักปลอมแปลงเหล่านี้

ธุรกิจขนาดเล็ก (และอาจรวมถึงขนาดใหญ่ด้วย) ที่ไม่ได้มีช่องทางชำระและโอนเงินอย่างเป็นทางการนั้นเสี่ยงตกเป็นเหยื่อของผู้ไม่ประสงค์ดีเหล่านี้ นักต้มตุ๋นใช้วิธีการส่งใบแจ้งหนี้ปลอมทางอีเมลโดยทำเสมือนว่าเป็นผู้จัดหาทรัพยากรที่เรียกร้องให้จ่ายเงินกันมานานแล้ว

ตอนนี้ด้วยเครื่องมือ AI ที่มีให้ใช้กันแพร่หลาย สแกมเมอร์สามารถโทร.หาพนักงานบริษัทแต่ละคน โดยปลอมเสียงเป็นผู้บริหารและอนุญาตให้มีการทำธุรกรรม หรือไม่ก็หลอกถามพนักงานให้เปิดเผยข้อมูลอ่อนไหวด้วยการชักจูงผ่านเสียงได้

“หากคุณพูดถึงการสวมรอยเป็นผู้บริหารเพื่อทำการฉ้อโกงมูลค่าสูงแล้วละก็ นั่นเป็นภัยคุกคามที่ทรงพลังและเกิดขึ้นจริงแม้ฟังดูไม่น่าเชื่อ” Rick Song ซีอีโอแห่ง Persona กล่าวโดยอธิบายว่าสิ่งนี้เป็นเรื่องที่เขากลัวมากที่สุดในการปลอมแปลงผ่านเสียง

ยืนยันตัวตนอย่างไรให้พ้นภัยมิจฉาชีพ

อาชญากรหันมาใช้งาน Generative AI กันมากขึ้นเพื่อเอาชนะผู้เชี่ยวชาญการป้องกันการปลอมแปลงทั้งหลาย หรือก็คือบริษัทเทคโนโลนีต่างๆ ที่เป็นผู้ดูแลความปลอดภัยตลอดจนรถขนเงินของ Brinks ผู้ให้บริการด้านความปลอดภัยแก่ธนาคารต่างก็พึ่งพาระบบการเงินดิจิทัลเสียส่วนใหญ่

หนึ่งในวิธีการหลักที่บริษัทเหล่านี้ให้ผู้บริโภคใช้ยืนยันตัวตน คือการบอกว่าพวกเขาแต่ละคนคือใคร เพื่อป้องกันการสูญเสียของทางสถาบันการเงินและลูกค้าไปพร้อมๆ กัน

สำหรับธุรกิจป้องกันการปลอมแปลงทางเดียวอย่าง Socure, Mitek และ Onfido พยายามให้มีการยืนยันตัวตนด้วย “การเปรียบเทียบภาพใบหน้า” พวกเขาจะให้คุณถ่ายรูปหรือวิดีโอ แล้วใช้ข้อมูลดังกล่าวเปรียบเทียบกับภาพของบัตรที่ใช้ยืนยันตัวตนได้ซึ่งคุณต้องส่งไปด้วยกัน

เมื่อรู้วิธีการทำงานของระบบดังกล่าว มิจฉาชีพจึงซื้อภาพใบขับขี่จริงจากตลาดมืด ใช้โปรแกรมแก้ไขวิดีโอที่ยิ่งมีราคาถูกและหาได้ง่ายขึ้นทุกวันเพื่อปลอมแปลงใบหน้าของตัวเอง จากนั้นจึงพูดคุยและสวมใบหน้าดิจิทัลของบุคคลอื่น เพิ่มโอกาสสำเร็จในการหลอกระบบเปรียบเทียบภาพใบหน้า

“การปลอมแปลงใบหน้าคุณภาพสูงมีจำนวนเพิ่มขึ้นอย่างมีนัยสำคัญ รวมถึงการจู่โจมแบบอัตโนมัติเพื่อสวมรอยเปรียบเทียบภาพใบหน้า” Song เผย เขาเสริมว่าตัวเลขที่สูงขึ้นแตกต่างกันไปในแต่ละอุตสาหกรรม แต่สำหรับบางภาคส่วน “เราอาจเห็นถี่ขึ้นสิบเท่าจากเมื่อปีที่แล้ว” บริษัทฟินเทคและเงินดิจิทัลต่างๆ ประสบจำนวนการจู่โจมที่เพิ่มขึ้นมากมายนัก

ผู้เชี่ยวชาญการปลอมแปลงบอกกับ Forbes พวกเขาคาดว่าผู้ให้บริการยืนยันตัวตนที่มีชื่อเสียง เช่น Socure หรือ Mitek อาจพบว่ามาตรการป้องกันการปลอมแปลงของพวกเขาคุณภาพตกลงเสียแล้ว อย่างไรก็ตาม Johnny Ayers ซีอีโอของ Socure แย้งว่า “นั่นไม่จริงเลยสักนิด”

เขาบอกว่าทางบริษัทเพิ่งปล่อยโมเดลใหม่เมื่อไม่กี่เดือนที่ผ่านมา อัตราจับการปลอมแปลงได้ก็เพิ่มขึ้นถึง 14% สำหรับตัวตนที่มีความเสี่ยงสูง 2% แรก อย่างไรก็ตามเขายอมรับว่าลูกค้าจำนวนมากยังล่าช้าในการรับเอาโมเดลใหม่ของ Socure ไปใช้ ซึ่งมีผลต่อประสิทธิภาพการทำงาน

“ธนาคารอันดับต้นๆ ของประเทศรายหนึ่งยังใช้รุ่นที่เก่ากว่าปัจจุบันถึง 4 เวอร์ชั่นอยู่เลย” Ayers รายงาน

ด้าน Mitek ปฏิเสธจะพูดถึงประสิทธิภาพการทำงานมาตรการของพวกเขา แต่รองประธานอาวุโส Chris Briggs ตอบว่าหากโมเดลที่กำลังพูดถึงกันอยู่นั้นถูกพัฒนาขึ้นเมื่อ 18 เดือนก่อน “ก็ใช่ คุณสามารถพูดได้ว่าโมเดลเก่ามีประสิทธิภาพไม่ดีเท่าโมเดลใหม่ๆ” ทว่าโมเดลของ Mitek ต่างก็ “ถูกพัฒนาซ้ำแล้วซ้ำเล่าตลอดเวลาโดยใช้กระแสข้อมูลจากชีวิตจริงและข้อมูลจากห้องปฏิบัติการ”

สถาบันทางการเงินรายใหญ่ของสหรัฐฯ ได้แก่ JPMorgan, Bank of America และ Wells Fargo ต่างปฏิเสธจะเปิดเผยเกี่ยวกับความท้าทายที่พวกเขาต้องเผชิญจากการปลอมแปลงด้วย Generative AI ส่วนโฆษกของ Chime ซึ่งเป็นธนาคารดิจิทัลรายใหญ่ที่สุดของประเทศและเคยประสบปัญหาการปลอมแปลงครั้งใหญ่มาก่อนเผยว่า พวกเขายังไม่พบว่าตัวเลขการจู่โจมผ่านการปลอมแปลงด้วย AI เพิ่มขึ้นแต่อย่างใด

บริษัทพัฒนา AI ก็หนักใจไม่แพ้กัน

โจรและนักต้มตุ๋นเบื้องหลังการหลอกลวงด้านการเงินทุกวันนี้มีตั้งแต่พวกที่ทำงานคนเดียว ไปจนกลุ่มอันซับซ้อนเต็มไปด้วยอาชญากรนับร้อยราย ขบวนการที่ใหญ่ที่สุดก็คล้ายกับบริษัท มีโครงสร้างองค์กรหลายชั้น พร้อมด้วยสมาชิกทักษะสูง รวมถึงนักวิทยาศาสตร์ข้อมูล

“พวกเขามีศูนย์คำสั่งและควบคุมของตัวเอง” Ranjan เล่า สมาชิกกลุ่มบางรายก็อาจทำแค่การชี้นำง่ายๆ อย่างส่งอีเมลเชิญชวนหรือโทร.หาเหยื่อ หากตกเหยื่อได้จากการปลอมเป็นธนาคาร ก็จะส่งต่อให้กับเพื่อนร่วมขบวนการที่สวมบทผู้จัดการสาขา และพยายามโน้มน้าวให้คุณโยกย้ายเงินออกจากบัญชี

อีกหนึ่งขั้นตอนสำคัญคือ พวกเขามักขอให้คุณติดตั้งโปรแกรมอย่าง Microsoft TeamViewer หรือ Citrix ซึ่งจะทำให้พวกเขาเข้าควบคุมคอมพิวเตอร์ของคุณได้ “พวกเขาอาจดับหน้าจอของคุณเสีย” Ranjan ว่า “สแกมเมอร์อาจใช้จ่ายหรือถอนเงินไปยังบัญชีอื่นๆ ของพวกเขา”

หนึ่งมุกต้มตุ๋นที่พบเห็นได้บ่อยๆ แม้จะเก่าไปบ้างคือบอกว่า บัญชีของเป้าหมายถูกมิจฉาชีพเข้าควบคุมแล้ว และขอเป้าหมายให้ความร่วมมือเพื่อดำเนินการเอาเงินคืน

ทั้งหมดนี้ไม่จำเป็นต้องพึ่งพา AI เลย แต่เครื่องมือ AI สามารถช่วยให้สแกมเมอร์เหล่านี้ทำงานได้อย่างมีประสิทธิภาพและเล่ห์กลดูน่าเชื่อถือยิ่งขึ้น

เทคโนโลยี Deepfake ตรวจจับใบหน้า

OpenAI พยายามนำเสนอตัวช่วยป้องกันไม่ให้ใครนำ ChatGPT ไปใช้เพื่อฉ้อโกง ตัวอย่างเช่น หากบอกให้ ChatGPT เขียนอีเมลขอให้ใครสักคนเปิดเผยเลขบัญชีธนาคาร โปรแกรมก็จะปฏิเสธ และตอบว่า “ฉันต้องขอโทษเป็นอย่างยิ่ง แต่ฉันไม่สามารถให้ความช่วยเหลือคำขอนั้นได้” อย่างไรก็ตาม การจะหลอกล่อโปรแกรมก็ยังทำได้ง่ายอยู่ดี

OpenAI ปฏิเสธจะให้การใดๆ ในประเด็นนี้ โดยชี้ไปยังเนื้อหาในบล็อกของพวกเขา หนึ่งในนั้นเผยแพร่เมื่อเดือนมีนาคม 2022 ซึ่งเขียนว่า “ยังไม่มีวิธีการใดใช้ควบคุมการใช้งานอย่างมีความรับผิดชอบได้โดยตรง ดังนั้นเราจึงพยายามเรียนรู้และมองหาข้อจำกัดในโมเดลต่างๆ ของเรา รวมถึงวิธีการที่เป็นไปได้ในการนำโมเดลไปใช้ในทางที่ผิด ณ ทุกขั้นตอนของการพัฒนาและการใช้งาน”

Llama 2 โมเดลภาษาขนาดใหญ่โดย Meta ถูกนำไปใช้เป็นอาวุธของกลุ่มอาชญากรได้ง่ายดายเสียยิ่งกว่า ด้วยเป็นการพัฒนาซอฟต์แวร์แบบ Open Source ใครๆ ก็ดูและใช้งานโค้ดทั้งหมดได้ ซึ่งเปิดทางที่กว้างกว่าเก่าแก่บรรดาผู้ไม่ประสงค์ดีให้นำไปพัฒนาเครื่องมือของตัวเองและสร้างความเสียหาย ผู้เชี่ยวชาญอธิบาย

อีกกรณีหนึ่งคือ ผู้คนสามารถสร้างเครื่องมือ AI ที่ส่งผลร้ายได้จากโมเดลดังกล่าว Meta เองก็ไม่ได้ตอบรับคำขอให้แสดงความคิดเห็นจาก Forbes เช่นกัน แม้ว่า Mark Zuckergerg ซีอีโอของ Meta จะเผยให้เดือนกรกฎาคมว่าการปล่อยให้ Llama เป็นแบบ Open Source สามารถยกระดับ “ความปลอดภัยและความมั่นคงได้ เพราะซอฟต์แวร์ Open Source นั้นเปิดให้ทุกคนเข้ามาตรวจสอบอย่างละเอียดมากกว่า ทำให้ใครๆ ก็สามารถค้นหาและชี้แนะวิธีการแก้ปัญหาได้”

บริษัทป้องกันการปลอมแปลงทั้งหลายยังคงพยายามสร้างสรรค์วิธีการไล่ตามเทคโนโลยีใหม่โดยเร็วที่สุด ใส่ใจประเภทของข้อมูลใหม่ๆ มากขึ้นเพื่อจับนักต้มตุ๋น

“การพิมพ์ การเดิน หรือการถือโทรศัพท์ของคุณ สิ่งเหล่านี้ก่อร่างเป็นตัวคุณ แต่ยังเข้าถึงไม่ได้ในแหล่งข้อมูลสาธารณะ” Ranjan ชี้ “เพื่อนิยามใครสักคนว่าเขาคือใครบนโลกออนไลน์ การมี AI ที่จำเป็นจึงสำคัญ”

พูดง่ายๆ ก็คือ มีแต่ต้องใช้ AI เพื่อจับ AI

จะปกป้องตัวเองจากนักต้มตุ๋มด้วย AI ได้อย่างไร

Forbes นำเสนอ 5 เคล็ดลับในการป้องกันตัวเองจากมิจฉาชีพที่อาจเลือกคุณเป็นเป้าหมายได้ ดังนี้

เสริมแกร่งแก่บัญชี: การยืนยันตัวตนหลายขั้นตอน (Multi-factor authentication หรือ MFA) จะขอให้คุณใส่รหัสผ่านและรหัสเพิ่มเติมในการยืนยันตัวเอง คุณควรใช้งาน MFA กับบัญชีทางการเงินทั้งหมดที่มี

มีความเป็นส่วนตัว: สแกมเมอร์สามารถใช้ข้อมูลต่างๆ ที่คุณเผยแพร่บนโซเชียลมีเดียหรือช่องทางออนไลน์เพื่อสวมรอยเป็นคุณได้อย่างแนบเนียน

สร้างรหัสวลี (Passphrase) : คนในครอบครัวสามารถยืนยันได้ว่าคนๆ นี้คือคนที่พวกเขารักจริงๆ โดยขอให้อีกฝ่ายพูดคำหรือวลีที่มีการตกลงกันไว้ล่วงหน้า ธุรกิจขนาดเล็กสามารถนำวิธีการนี้มาประยุกต์ใช้เพื่อรับรองการดำเนินการต่างๆ เช่น การขอโอนสายโดยผู้บริหาร พึงระวังข้อความจากผู้บริหารที่ขอให้มีการชำระเงินด้วยบัตรของขวัญ นี่คือวิธีการหลอกลวงที่พบได้บ่อย

ปั่นหัวพวกเขาเสีย: หากคุณสงสัยว่ามีบางอย่างไม่ชอบมาพากลระหว่างคุยโทรศัพท์ ให้ลองสุ่มคำถามดู เช่น สภาพอากาศในเมืองที่พวกเขาอยู่ตอนนี้เป็นอย่างไร หรือไม่ก็เรื่องที่ดูเป็นส่วนตัวที่ทำให้เหล่าสแกมเมอร์หาทางสุ่มตอบคำถามถูกต้องได้ยาก โดยทั้งหมดนี้ คือคำแนะนำจาก Frank McKenna ผู้ร่วมก่อตั้งบริษัทป้องกันการปลอมแปลง PointPredictive

แปลและเรียบเรียงจาก How AI Is Supercharging Financial Fraud–And Making It Harder To Spot ซึ่งเผยแพร่บน Forbes

อ่านเพิ่มเติม : Linden Lazarus ชายหนุ่มผู้พลิกความหลงใหลสู่ธุรกิจนาฬิกาสิบห้าล้านเหรียญ

ไม่พลาดบทความและเรื่องราวน่าสนใจอื่นๆ ติดตามเราได้ที่เฟซบุ๊ก Forbes Thailand Magazine